4 de agosto de 2024

El 1 de agosto entró en vigencia la nueva regulación europea sobre Inteligencia Artificial (IA). El Reglamento de IA de la Unión Europea (UE) armoniza normas sobre las tecnologías de aprendizaje automatizado y llevó años de laboriosas consultas con organismos de derechos humanos, especialistas, políticos de distintas corrientes y empresas. La Unión Europea destaca que su regulación sobre IA contiene «salvaguardias para proteger los derechos fundamentales de las personas» y que la nueva ley «está diseñada para garantizar que la IA desarrollada y utilizada en la UE sea fiable».

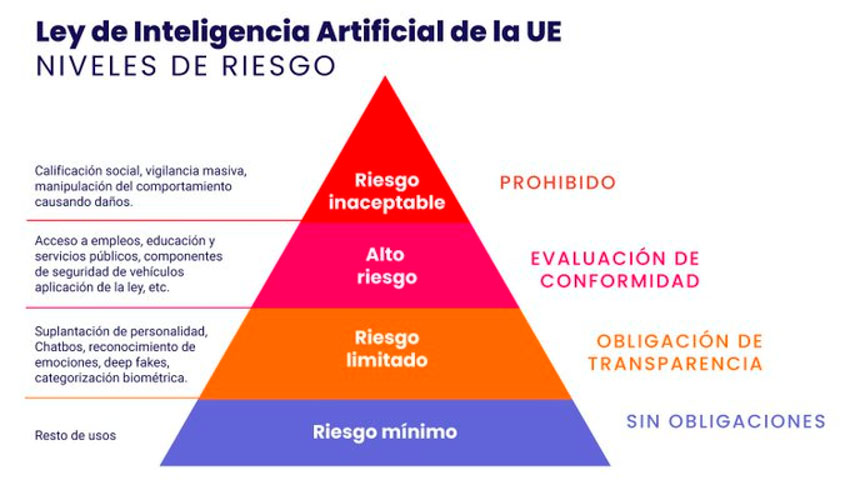

En contraste, el Gobierno argentino de Javier Milei avanza a golpe de resoluciones carentes de consulta pública, creando dependencias oficiales de patrullaje digital que invocan el uso de IA para recortar derechos constitucionales. Lo que habilita el Ministerio de Seguridad, a cargo de Patricia Bullrich, está vedado en Europa, cuya regulación organiza los sistemas de IA en cuatro niveles de riesgo:

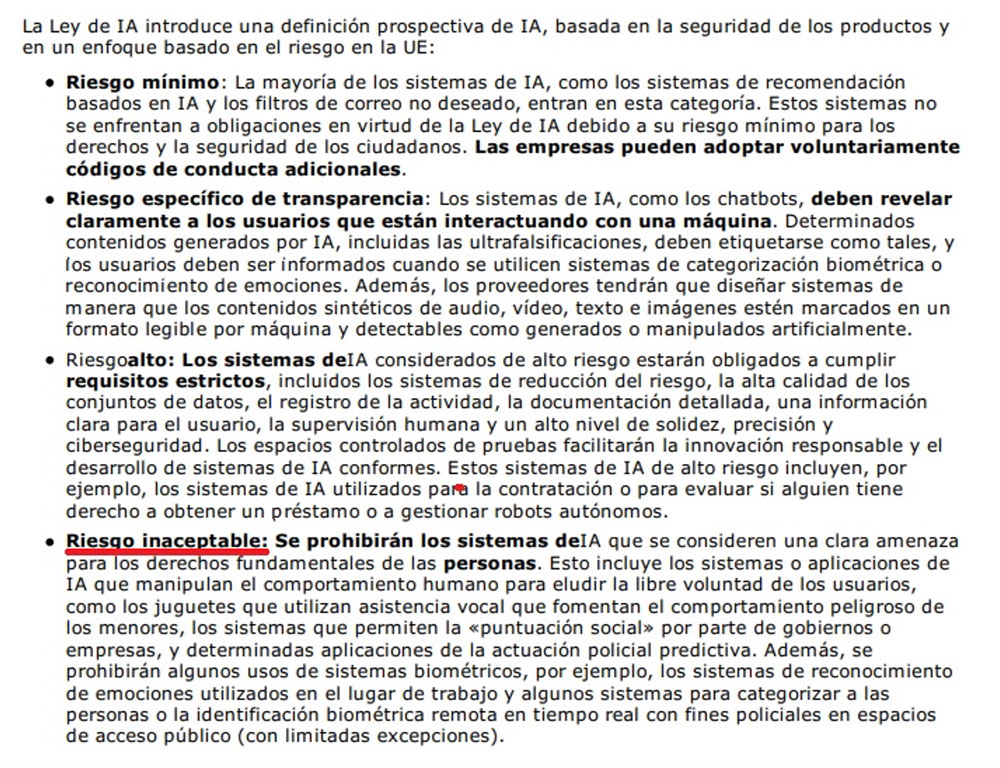

Esos niveles de riesgo de las herramientas de IA son explicados en el siguiente resumen realizado por la Comisión Europea:

En el resumen está subrayado el párrafo del nivel más alto de riesgo (señalado como «inaceptable») con los usos prohibidos de sistemas IA. Se trata de tecnologías que son una «clara amenaza a los derechos fundamentales de las personas», como «los sistemas o aplicaciones de IA que manipulan el comportamiento humano para eludir la libre voluntad de los usuarios, como los juguetes que utilizan asistencia vocal que fomentan el comportamiento peligroso de los menores, los sistemas que permiten la “puntuación social» por parte de Gobiernos o empresas, y determinadas aplicaciones de la actuación policial predictiva».

Además, la regulación europea de Inteligencia Artificial veta ciertos usos de sistemas biométricos, como «los sistemas de reconocimiento de emociones utilizados en el lugar de trabajo y algunos sistemas para categorizar a las personas o la identificación biométrica remota en tiempo real con fines policiales en espacios de acceso público (con limitadas excepciones)».

Ahora bien, ¿por qué es importante conocer el Reglamento de Inteligencia Artificial de la UE? Porque se trata de la primera regulación integral de IA, construida en años de trabajo y consultas multisectoriales, que complementa otras normas producidas en Europa sobre entornos digitales.

Europa ha sido pionera en adecuar sus normas de protección de datos personales a la «plataformización» de Internet. Aparte, el año pasado aprobó dos leyes sobre derechos de usuarios y competencia económica de cumplimiento obligatorio para grandes plataformas: la Digital Services Act (DSA) y la Digital Markets Act (DMA).

El conjunto de estas regulaciones eleva los estándares de calidad y la exigencia de protección de personas usuarias y consumidoras de aplicaciones y servicios digitales, lo que es conocido como «efecto Bruselas», pues lleva al resto del mundo a tomar como ejemplo los avances europeos para luego adaptar, traducir o, en algunos casos, apartarse de esa experiencia. Las iniciativas de regulación de IA en toda América del Norte siguen la senda trazada por la UE.

En Brasil, el ambicioso plan nacional de IA lanzado por el Gobierno de Lula da Silva, que prevé invertir más de 4.000 millones de dólares hasta 2028, también cita el modelo de Europa. En la Argentina, el próximo martes la Cámara de Diputados discutirá en comisión varios proyectos de ley para regular aspectos de las tecnologías de Inteligencia Artificial que, en su mayoría, consideran valiosa la vía europea en la materia.

Sin embargo, al comparar la letra de la más moderna, integral y fundamentada regulación sobre Inteligencia Artificial en el mundo vigente en Europa, por un lado, con la Resolución 710/24 del Ministerio de Seguridad del Gobierno argentino publicada el lunes pasado en el Boletín Oficial, se advierte que esta expresa su antítesis.

Foto: Getty Images

Todo lo que la Unión Europea califica como «riesgo inaceptable» y está prohibido o severamente limitado en su ley es, en cambio, objetivo explícito de la nueva dependencia oficial argentina de patrullaje de redes, aplicaciones y sitios de Internet dedicada a «predecir futuros delitos» utilizando «algoritmos de aprendizaje automático», «crear perfiles de sospechosos» y «analizar actividades en redes sociales para detectar amenazas potenciales».

La presunción de inocencia, la privacidad o la libertad de expresión son derechos amputados por las funciones asignadas por la ministra Bullrich a la nueva dependencia oficial que, además, se superpone en algunos de sus objetivos con otras áreas del propio Poder Ejecutivo y, en particular, con la Secretaría de Inteligencia del Estado (SIDE).

Nada impide que las fuentes de entrenamiento de la IA de Bullrich, tan opacas e inauditables como los fondos reservados de la SIDE, deriven en «falsos positivos», en la invasión a la privacidad sin orden judicial y en la persecución de personas o grupos simplemente por no coincidir con la ideología de Milei y el elenco gobernante. Bullrich ya impulsó la denuncia penal de tuiteros en uno de sus previos ejercicios como ministra, cuando gobernó Mauricio Macri. Después de un calvario judicial, los denunciados resultaron absueltos.

La inviolabilidad de las comunicaciones personales tampoco es un derecho considerado con la creación de la Unidad de Inteligencia Artificial de Bullrich, que complementa la política de ciberpatrullaje para perseguir cibercrímenes que la ministra repuso, y amplió, por Resolución 428/2024, excediendo los estándares internacionales en la materia y sosteniendo una viscosa definición respecto de qué conductas serán objeto de investigación criminal.

Si la UE enfatiza la necesidad de garantizar la transparencia a lo largo de la cadena de valor y «los posibles riesgos sistémicos de los modelos más capaces», la política oficial en la Argentina asume, por el contrario, el riesgo de socavar las protecciones constitucionales inherentes al estado de derecho.

1 comentario

Los comentarios están cerrados.