24 de noviembre de 2023

El creador del chat GPT fue despedido de su cargo por diferencias comerciales y éticas iniciando idas y vueltas. Una noticia que va más allá del mundo de los negocios por las implicaciones para la sociedad y la política.

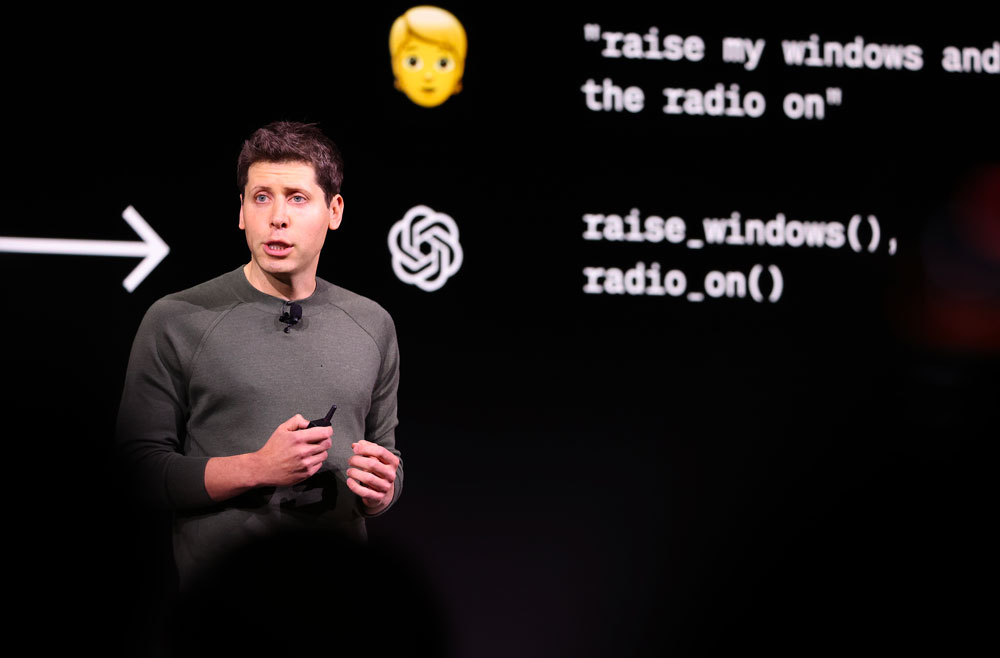

Sam Altman, el CEO de OpenAI (la fundación que desarrolló ChatGPT y lidera el mundo de la Inteligencia Artificial) fue despedido la semana pasada de su cargo y contratado por Microsoft para que continúe allí con su trabajo. Sin embargo, se provocó tal crisis interna en OpenAI que el concejo fue desplazado y Altman recuperó su cargo en OpenAI.

La noticia que, parecería, solo interesa al mundo de los negocios es un reflejo profundo de la forma en la que operan los negocios tecnofinancieros que, además, en este caso, manejan una tecnología con efectos sociales poco claros, pero que pueden llegar a ser realmente problemáticos para la economía, la sociedad y la política, en un momento histórico ya cargado de inestabilidad.

Vale la pena comprender la raíz del problema haciendo un poco de historia.

Una fundación

OpenAI se creó como fundación sin fines de lucro en 2015 de la mano de inversores conocidos como Elon Musk o Sam Altman y otros de perfil más bajo como Ilya Sutskever, entre otros.

Entre todos reunieron más de 1.000 millones de dólares con el objetivo de desarrollar una Inteligencia Artificial (IA) «amigable» y segura para la sociedad. Desde principios de siglo, incluso antes de las evidencias del poder creciente de distintos tipos de IA, se levantaron voces preocupadas por garantizar que los desarrollos en el área se fundaran en principios éticos incuestionables y que la competencia entre empresas capitalistas no generara un desarrollo descontrolado y cuyas consecuencias no estaban claras. En el sitio de la fundación lo resumen así: «Nuestra misión es asegurar que la IA beneficie a toda la humanidad».

Luego de varios fiascos tecnofinancieros como las criptomonedas o el Metaverso, los fondos de inversión detectaron que la IA realmente estaba a la altura de las expectativas y comenzaron a aumentar su interés por ella. Las empresas dedicadas al desarrollo, por su parte, estaban ávidas de capitales para seguir contratando a los mejores cerebros disponibles, comprar o alquilar supercomputadoras capaces de procesar números astronómicos de datos para entrenar a sus IA, pagar la enorme cantidad de energía necesaria para mantenerlas funcionando y también para diseñar algunas herramientas que generen ingresos.

OpenAI era una más de las empresas del campo y contaba con algunos hitos de cierta repercusión, por ejemplo, cuando uno de sus modelos logró ganar una competencia de Dota 2 (un videojuego muy popular) en 2017. La IA se había entrenado jugando contra sí misma solo dos semanas y eso le alcanzó para superar a humanos entrenados durante años.

En 2018, Sam Altman creó una subsidiaria de la fundación, OpenAI Limited Partnership, que sí tenía fines de lucro y que permitió canalizar inversiones. Una de ellas, de 1.000 millones de dólares (que llegaron luego a 13.000 millones), provino de Microsoft. Si bien la fundación tenía un límite para repartir ganancias, esta intervención le dio a la corporación de Bill Gates acceso privilegiado a los desarrollos que se hacían dentro de OpenAI. Así fue que la parte empresaria comenzó a crecer y a opacar los ideales de la fundación hasta el punto de que Elon Musk comenzó a quejarse por lo que veía como una apropiación de su idea inicial por parte de capitales privados que buscarían un crecimiento rápido para doblegar rivales sin medir las consecuencias.

Llega ChatGPT

Es en este contexto que, en noviembre de 2022, se lanzó ChatGPT y las cosas se aceleraron. La herramienta, disponible en la web, permitió que los no especialistas vieran de primera mano el poder de la IA, en particular de un modelo de lenguaje general capaz de mantener diálogos, hacer traducciones, escribir programas informáticos, realizar tareas de atención al cliente, etcétera. Muchos comprendieron en ese momento que la IA Generativa representaba un salto cualitativo formidable y obligaba a replantear su gobernanza. En marzo se publicó la famosa carta de cientos de especialistas, cuya cara más visible fue Elon Musk, expresando preocupación por los efectos de la IA y pidiendo una pausa en su desarrollo hasta que pudieran crearse las salvaguardas necesarias.

Este dilema a escala social es el que se reprodujo en el interior de OpenAI: por un lado está la lógica empresaria que empuja a crecer lo más rápido posible en un mundo tecnológico en el que llegar primero es clave. Por el otro lado, están quienes piden un crecimiento más responsable que prevenga los aspectos más peligrosos de la IA antes de que se desplieguen.

Justamente este fue el tema de una charla TED brindada en octubre pasado por uno de los fundadores de OpenAI, el ya mencionado Sutskever. En la exposición, llamada «El excitante, peligroso viaje hacia una IAG», el especialista explica que estamos camino al desarrollo de una Inteligencia Artificial General (IAG). Si bien, por ejemplo, ChatGPT puede dialogar de manera verosímil en numerosos idiomas sobre casi cualquier tema, no puede, por ejemplo, diseñar los planos de una fábrica o decirnos cuál es la mejor ruta para llegar a un destino. Una IAG sí podrá manejar cualquier tema con soltura.

Si bien Sutskever afirma que el potencial de una IA así para la humanidad es enorme, también lo es su capacidad de daño. Él fue uno de los miembros del concejo de OpenAI que votó por el despido de Altman. Si bien la excusa fue que no era transparente en su gestión, todo indica que el problema era una mirada empresaria que priorizaba la velocidad por sobre… bueno, poner en riesgo a la humanidad. De alguna manera, la decisión del concejo era una advertencia en favor de la sensatez.

Hasta hace unos años, Mark Zuckerberg repetía a sus empleados «muévanse rápido, rompan cosas». Esa frase representaba la audacia de Silicon Valley, su voluntad para crecer y desarrollar ideas y negocios sin restricciones. Las consecuencias de esta forma de trabajar se hicieron evidentes en un sinnúmero de casos como el escándalo de Cambridge Analytica o, más recientemente, el juicio contra Meta por producir una crisis de salud mental en la juventud estadounidense. La IA es una tecnología transversal a un sinnúmero de áreas en las que podría tener gran impacto.

Cuando Altman fue despedido se generó una crisis en OpenAI; cientos de empleados pidieron que lo volvieran a contratar. Entre los firmantes estaba el mismo Sutskever, quien había votado por su despido, pero se arrepintió al ver el daño provocado a OpenAI. Aunque Microsoft ya había contratado a Altman y a muchos de los especialistas que decidieron seguirlo, finalmente el concejo echó a algunos de sus miembros (entre ellos a las dos miembros mujeres) y trajo nuevamente a su CEO. Altman había dicho en varias ocasiones que gracias a que la corporación madre era una fundación el concejo podría echarlo en caso de que hiciera algo reñido con «los intereses de la humanidad». Al parecer, no era tan así.

Evidentemente, todos se movieron rápido. Ahora falta saber si, además, romperán cosas.

7 comentarios

Los comentarios están cerrados.